01

AI 爆发,算力告急

我们已全面进入“大数据”时代,人工智能技术深入自动驾驶、智能教育、语音识别等众多领域。在这一进程中,人工神经网络作为AI的核心计算模型,成为推动社会智能化发展的关键引擎。

然而,神经网络的运行极度依赖矩阵乘法——无论是模型训练还是实际推理,本质上都是在处理海量数据的矩阵运算。随着模型规模持续暴涨(据估算,深度学习模型的参数量约每3.5个月翻一番),所需的矩阵计算日益密集,对算力的需求正以前所未有的速度攀升。传统电子芯片逐渐触及性能与能效瓶颈,而光计算以其特有的低功耗、高带宽、低延迟优势,正展现出突破现有算力困局的全新可能。

光计算简史:从光学实验到神经网络

1940年代

光计算启蒙,傅立叶变换被引入光学。

1960年代

激光问世,光学模拟信息处理起步。

1980年代

神经形态计算兴起,误差反向传播算法提出,光学神经网络首次实验实现。

1990年代

动态非线性晶体出现,实现三维光存储,曾演示存储约10亿个权重的面部识别网络。

21世纪以来

随着硅光子学进步,光学神经网络重新成为研究热点。

02

常见光计算器件:光如何“做计算”?

光波导

相当于“光的导线”,可用于传输和引导光信号,材料、结构多样。

马赫曾德尔干涉仪

包含分束器、相移器和合束器,可用于光强度调制,是集成光芯片中的关键调制单元。

分束器

通常是一种对称性器件,将来自于一个直波导的光功率等分。

定向耦合器

一种具有双输入、双输出端口的光学器件,由两条紧密相邻的光波导构成。当光在其中一条波导中传播时,部分能量会因波导间的耦合作用,周期性转移至另一条波导中,从而实现光信号任意比例的分束。

相位调制器

通过改变光波导材料折射率从而调节光信号相位。最常见的相位调制器有基于热光效应、载流子色散效应、电光效应、相变材料等机制。

03

光计算原理:为什么光比电快?

矩阵乘法是典型的线性运算,光通过可编程的光子矩阵计算(Optical Multiply Accumulate,oMAC)可实现高速并行处理:

输入向量值首先从片上存储中提取,由数模转换器转换为模拟值,通过电子芯片和光子芯片之间的微凸点应用于相应的光调制器,形成输入光矢量;

输入光矢量传播过程中经过矩阵光路,自然而然完成光计算产生输出光矢量,在经过探测器后转为电流信号;

电流信号通过跨阻放大器和模数转换器返回数字域。

光计算三大优势:

延迟极低:光计算本质上就是光在芯片中的传输过程,因此计算延迟约等于光在芯片内传播的时间,可低于1ns。实际运算中,主要耗时来自于光电转换与数模转换,通常仅为几个时钟周期,且与矩阵大小几乎无关,单次光子矩阵计算的整体延迟可控制在3ns以内。

能耗更少:光计算功耗主要来自电光转换,在光学器件和其控制电路被较好的优化前提下,能媲美甚至凌驾先进制程的数字芯片。

不依赖先进制程:光计算芯片通常采用成熟制程实现,例如28nm及以上工艺节点即可满足大多数设计需求,这与当前AI算力高度依赖3nm/5nm/7nm先进制程的电芯片形成鲜明对比。

04

光计算硬件:PACE系列光电混合计算加速卡

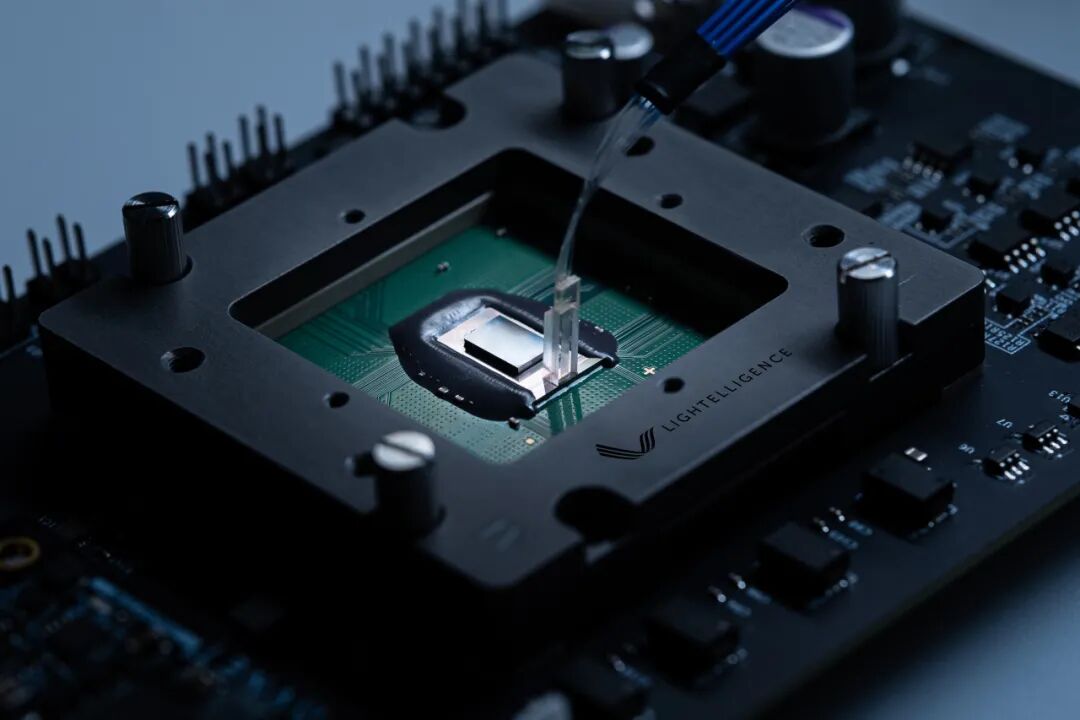

PACE

曦智科技于2021年发布了光子计算处理器 PACE,其核心是一个64×64 光学矩阵乘法器,采用硅光芯片与CMOS芯片2.5D堆叠封装。在求解伊辛问题等NP完全问题时,PACE单次迭代仅需3纳秒,速度可达高端GPU的800倍以上。

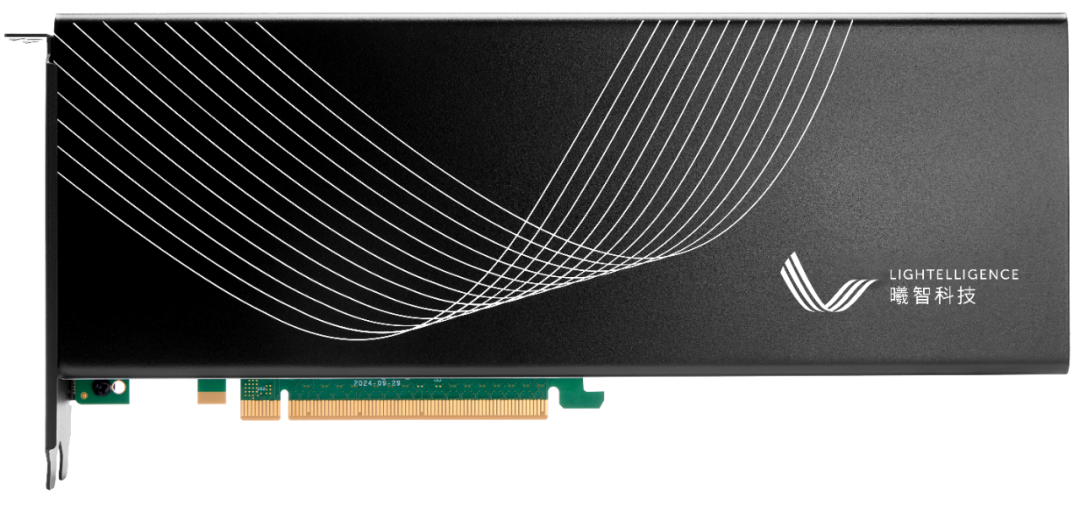

PACE 2(曦智天枢)

曦智科技2025年推出的全新支持商用算法的光电混合计算加速卡,包含目前全球最大规模128x128光子矩阵,具备复杂可编程性,用户可自由配置矩阵系数,通过PCIe高速接口可无缝集成现有计算系统,适用于多种商用场景。

光计算应用场景:

生物信息:加速蛋白质结构预测、基因测序等计算。

路径规划:高效求解物流调度、旅行商问题等组合优化任务。

材料研发:辅助新材料仿真与设计,缩短研发周期。

人工智能:加速神经网络中的矩阵运算,提升图像识别、语音处理等AI任务效率。

光计算,正以高速、低耗的独特优势,从实验室走进产业视野。它不仅是突破算力瓶颈的潜力技术,更有望与现有计算系统深度融合,为AI、科学计算等领域构建下一代基础设施。

那么,在你看来:

光计算将最先在哪个领域转化为大规模应用? 是它天生契合的AI推理,还是能解决燃眉之急的生物计算,或是其他我们尚未充分想象的场景?

扫描以下二维码或点击“阅读原文”查看原论文内容。